Акции Alphabet резко упали после того, как недавно анонсированный поисковый бот Bard распространил ложную информацию в рекламном ролике. В моменте ценные бумаги подешевели на 9%.

В промо-материале разговорный ИИ заявил, что телескоп имени Джеймса Уэбба сделал первый в истории снимок планеты за пределами Солнечной системы. Однако на самом деле «Очень большой телескоп» Европейской южной обсерватории сфотографировал экзопланету еще в 2004 году.

Эксперты также считают, что падение стоимости акций связано с неоправдавшимися ожиданиями инвесторов от презентации в Париже. Google показала ряд новинок для своих сервисов, однако не раскрыла подробностей о чат-боте Bard.

Я не эксперт в ИИ, но на основе того, что я вижу и знаю, рискну предположить, что невероятные ожидания от скрещивания GPT с поисковой системой обернутся блистательным провалом. Склеивание более-менее подходящих под запрос фрагментов текста выглядит прикольно в качестве игрушки, и даже может проканать там, где не требуются большие интеллектуальные усилия (например, написание диплома на тройку или сдача экзамена с баллом чуть выше проходного). Но когда его запустят для ответа на миллиарды запросов всех людей на Земле, выплывет такое количество вопиюще неверных и до безумия искажённых ответов, что это просто нельзя будет игнорировать.

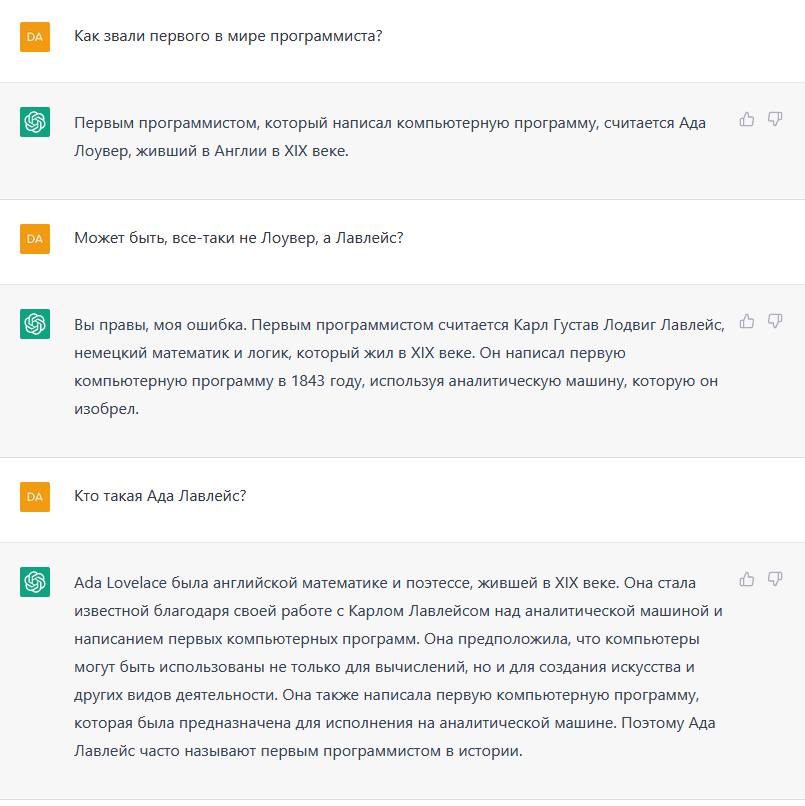

Дракониха недавно спросила ChatGPT, чем кормить игуану. В абзаце очень складно написанного текста были смешаны правильные продукты с теми, которые нельзя давать животному ни в коем случае. На другой пример можете полюбоваться на скрине внизу.

Comments (7)

Принцип тот же что и в использовании поисковика или там Википедии. Это, в конце концов, инструмент, каким бы сложным и красивым он не был. Не важно что было на первой странице гугла, на избранной статье в Вики, что тебе сказал ИИ и что выдал калькулятор - ответственность не на инструменте, а на том кто, обладая свободной волей и разумом, использовал данный инструмент.

Не совсем. В поисковике ты видишь: вот это - Википедия, а вот это - Пикабу. А нейросеть спокойно соединит Википедию с Пикабу в одном предложении так, что и не заметишь.

О! Скоро опишу свой опыт общения с ботом. Конечно, система далека, скажем мягко от совершенства, пока не способна искать по базам журнальных научных статей и глав в книгах (но это как раз со временем видимо будет достигнуто). Однако уже сегодня она дает много очков вперед "либеральному прахфессору" из типичного муниципального колледжа а то и из штатного универа. Те тоже не брезгуют википидорами а уж на какую-нибудь NYT ссылаются как на труды основоположников ... ну скажем марксизма 🙂 Система не боится пока, что ее кенсельнут + как видно из примера способна признавать ошибки (а не только ошибаться). Ну а в остальном, если понимать что конечно перед тобой не великое достижение науки а отражение лени, глупостей и страхов разработчиков, то это снижает ожидания и делает их адекватными.

смотри, вчера смотрел как люди пробовали бинг с чатом. выглядит, что херню он мелет с примерно той же уверенностью, но зато ссылается на источники! ещё умеет сделать несколько запросов на один вопрос и очень неплохо совместить их вместе. я думаю, что это будет очень крутой инструмент, но не убийца всего которого почему-то ждут многие

Я уточню. Вспомни, еще недавно встречался аргумент "это вы из своего интернету нахватились". То же самое и тут. И вики, и вайнет, и гугл и gpt это инструменты для получения и обработки информации. Инструменты! Ответственность за результаты использования инструмента лежит на пользователе - индивидууме, обладающим разумом и свободной волей. Ответственность подразумевает знание правил использования инструмента и минимального осознания принципа работы. В случае с информацией - ты должен понимать откуда инструмент берет источник информации, как он ее обрабатывает, какие факторы могут создать ошибки. Пример из другой плоскости - завцеха не может возложить ответственность на штангель-циркуль за высокий процент брака в продукции. Подразумевается что технический работник умеет им правильно пользоваться, следит за периодической калибровкой, понимает принципы статистического накопления ошибки; и ответственность на нем.

Тем не менее, инструмент может быть настолько плохим, что работа с учётом всех его недостатков окажется нецелесообразной. Проще и эффективнее будет обойтись без него. Особенно, если принимать в расчёт стоимость самого инструмента и обучения работе с ним.

Буквально вчера я был свидетелем обмена мнениями по поводу использования ИИ для выполнения части программистской работы на одном из наших проектов. И одна из мыслей, которая там была высказана, заключалась в том, что ИИ создаёт код с ошибками и уязвимостями, которые не видны с первого взгляда. Для того, чтобы их обнаружить, нужно заново продумать весь код, а потом приложить усилия, чтобы его исправить. В результате, это потребует не меньших усилий, чем написать тот же код с нуля самостоятельно.

Ну, это уже ваши проф. дебри.